31.01.2024

R. Caso, Verso una città smart e dispotica? No del Garante privacy ai progetti MARVEL e PROTECTOR del Comune di Trento, vesione 1.0, 31.01.2024, Zenodo pubblicato su L’Adige del 03.02.2024 con il titolo “L’equilibrio tra privacy e sicurezza” (v. anche R. Caso, Sorveglianza artificiale, sicurezza urbana e privacy, 10 novembre 2023, pubblicato su L’Adige del 14 novembre 2023 con il titolo “Intelligenza artificiale. Dubbi e domande su Marvel e Protector“).

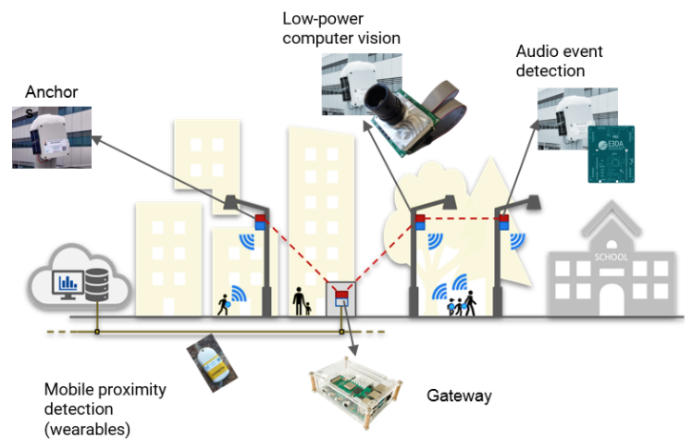

Con un provvedimento di quaranta pagine dell’11 gennaio scorso il Garante per la protezione dei dati personali ha dichiarato, in base al Regolamento dell’Unione Europea 2016/679 (GDPR) e al Codice italiano in materia di dati personali (d.lgs. 2003/196), l’illiceità del trattamento dei dati personali effettuato dal Comune di Trento nell’ambito dei progetti di ricerca MARVEL e PROTECTOR. Si tratta di studi finanziati dall’Unione Europea e connessi al progetto “Trento smart city”. Tali ricerche prevedevano la raccolta di informazioni personali in luoghi pubblici attraverso telecamere di videosorveglianza e microfoni nonché da social network al fine di rilevare, tramite software di intelligenza artificiale, potenziali situazioni di pericolo per la pubblica sicurezza anche con riferimento a luoghi di culto religioso. La finalità del trattamento dei dati personali era perciò l’addestramento dei software di intelligenza artificiale.

Il Garante privacy ha ordinato al Comune di Trento il pagamento di una sanzione di 50.000 Euro, riducibili alla metà se il pagamento avviene entro 30 giorni, ha vietato di trattare i dati personali già raccolti e ha imposto la cancellazione degli stessi. Infine, l’autorità garante ha disposto la pubblicazione del provvedimento sul proprio sito web. La sanzione non è elevata perché il Garante ha riconosciuto al Comune di aver agito in buona fede. Ma i motivi di illeceità rilevati dal Garante sono gravi e molteplici: assenza di una base giuridica per la liceità del trattamento; insufficiente trasparenza del trattamento; mancanza delle misure necessarie a proteggere i dati e a ridurre i rischi.

A parere del Garante, la mancanza di una base giuridica è tanto più grave per il fatto di riguardare dati estremamente sensibili, relativi a crimini e a convinzioni religiose, oggetto, nell’ambito della normativa sulla privacy, di una disciplina speciale volta rafforzare la tutela delle persone. Sul profilo della trasparenza l’autorità ha evidenziato che le informative di primo (segnaletica e cartelloni stradali di avvertimento) e di secondo (il sito web del Comune) livello erano carenti, cioè non mettevano le persone che passavano nelle zone sorvegliate di conoscere i dettagli relativi al trattamento dei dati personali. Sul piano delle misure di prevenzione il Garante ha rilevato che le tecniche di anonimizzazione erano deficitarie e non era stata effettuata la valutazione d’impatto dei trattamenti previsti sulla protezione dei dati personali. Un altro profilo di gravità attiene al fatto che i dati erano destinati ad essere comunicati ai partner dei progetti internazionali (nell’ambito del progetto PROTECTOR i dati erano condivisi con la Polizia di Anversa e con il Ministero dell’Interno della Bulgaria).

Sul proprio sito web il Comune il 24 gennaio affermava che avrebbe valutato nei giorni successivi se presentare opposizione al provvedimento del Garante davanti al giudice ordinario. Il 30 gennaio il Sindaco del Comune di Trento ha rilasciato un’intervista al quotidiano La Repubblica. Secondo quanto riportato dal giornale “per il sindaco la questione non è solo trovare un equilibrio tra il rispetto della privacy e la garanzia di sicurezza, ma anche ‘realizzare degli strumenti per conto nostro o rimanere indietro e dover utilizzare quelli degli altri, che magari li progetteranno con minore cura’”.

Quest’ultima asserzione, se presa alla lettera, induce a porsi domande molto serie e impellenti.

- In un Paese democratico come l’Italia, la prevenzione e il contrasto al crimine commesso negli spazi pubblici sarà sempre più affidata a tecnologie digitali di controllo pervasivo come videocamere, microfoni, sensori, software di monitoraggio dei social network?

- Per smart city si deve intendere una città che affida la sua sicurezza alla sorveglianza di massa?

- Quale fondamento scientifico hanno i software di intelligenza artificiale che promettono di rilevare potenziali situazioni di pericolo per la pubblica sicurezza?

- Se questo fondamento scientifico esiste, i cittadini hanno diritto a conoscere la logica alla base degli algoritmi di intelligenza artificiale?

- Si vuole dotare la polizia locale di maggiori poteri di intervento nel campo della sicurezza pubblica?

- L’Europa è destinata ad avvicinarsi sempre di più ai Paesi occidentali e non (si pensi ad alcuni Paesi asiatici) dove la sorveglianza tecnologica di massa è ormai è un dato acquisito e giudicato compatibile con il diritto e la giustizia?

- Davvero l’alternativa è tra produrre in proprio una tecnologia predittiva o acquistarla da altri?

Tali quesiti non possono essere risolti solo affidandosi a un’interpretazione più o meno sofisticata di regolamenti europei e leggi nazionali, ma attengono a scelte politiche che devono muoversi nel perimetro delle norme costituzionali poste a fondamento delle società europee democratiche. Il vagheggiato bilanciamento tra privacy (libertà) e sicurezza implica la responsabilità di dover scegliere qual è il piatto della bilancia che pesa di più.